La Universidad de Purdue crea un sistema que detecta gestos táctiles y de la mano en cualquier superficie

Con la ayuda del sensor Kinect de Microsoft, los ingenieros de la Universidad de Purdue (欧盟) han creado un sistema que puede convertir cualquier superficie -plana o de otro formato- en una pantalla multi-táctil y multi-usuario.

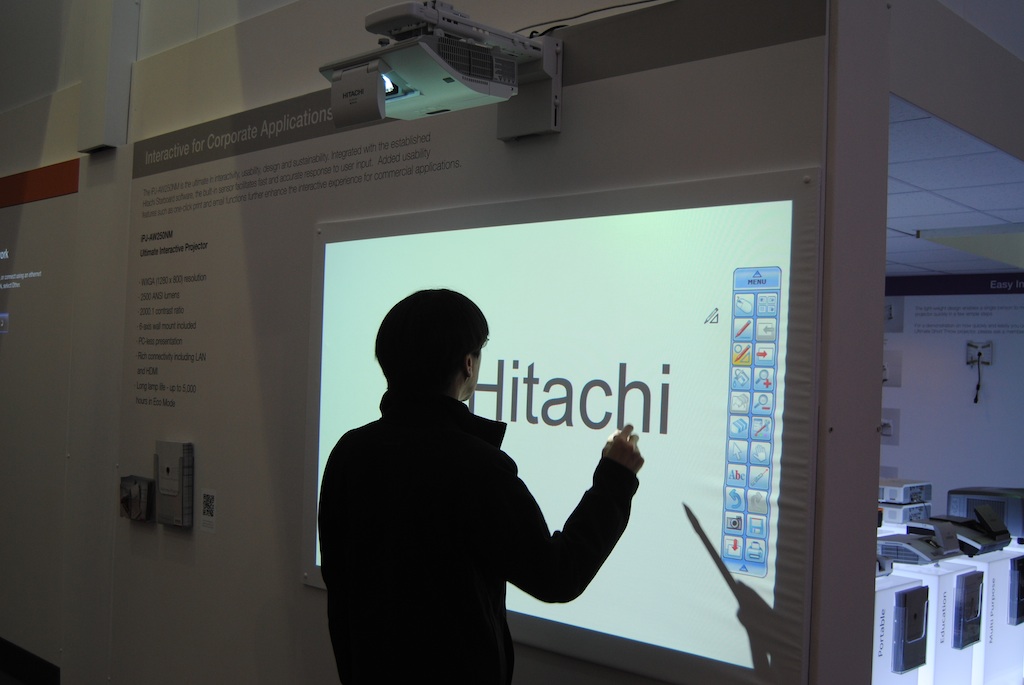

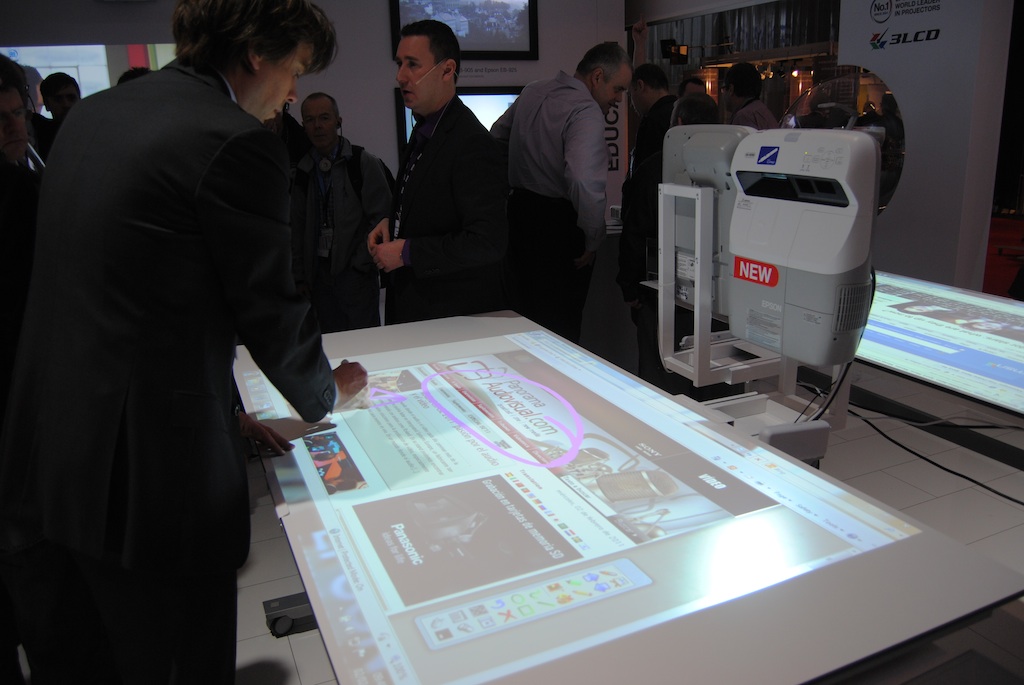

Investigadores de la Universidad de Purdue, ubicada en West Lafayette (印第安纳州, 美国) han desarrollado un sistema ‘multi-táctil extendido’ que consta de un ordenador, un proyector de vídeo y una cámara Kinect de 微软 y que permite transformar cualquier superficie en una interfaz de pantalla táctil, que puede rastrear múltiples manos simultáneamente.

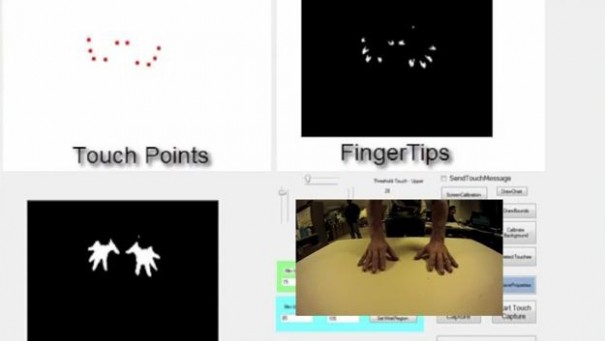

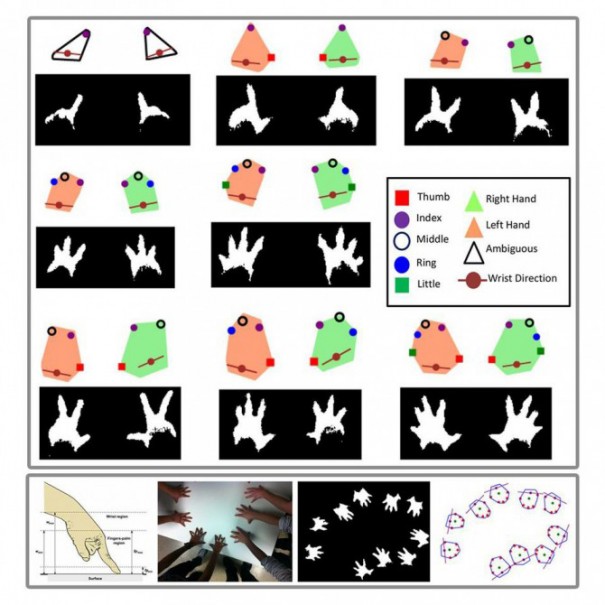

El sistema proyecta una imagen de la interfaz en una superficie plana como una mesa o una pared, aunque el material del que esté hecha la superficie es irrelevante. La cámara Kinect con detección de profundidad está entrenada en esa imagen, y es capaz de detectar la distancia a la que están las manos del usuario. Con el fin de ser capaz de identificar esas manos como manos, el software que se ejecuta en el ordenador incorpora un modelo de mano digital, que permite al sistema reconocer un objeto como una mano cuando ‘ve’ una a través de la cámara. Ese modelo también puede diferenciar entre diversas partes de la mano, y entre la mano izquierda y la derecha.

Karthik Ramani, profesor de Ingeniería Mecánica de la Universidad de Purdue, 已解释: “La cámara ve dónde tiene las manos el usuario, qué dedos está presionando sobre la superficie, sigue los gestos de sus manos y reconoce si hay más de una persona trabajando al mismo tiempo. Se pueden realizar tareas de precisión, como escribir con un lápiz, con la mano dominante, y cosas más generales, como la selección de colores, usando la mano no dominante.”

到目前为止, las pruebas de laboratorio han demostrado que el sistema tiene una tasa de precisión del 98 por ciento para determinar la postura de la mano -un elemento clave a la hora de ser capaz de reconocer los gestos de las manos-. Las nuevas cámaras más precisas deberían impulsar ese nivel de éxito aún más, permitiendo que el sistema multi-táctil extendido tenga un uso práctico.

Ramani ha añadido: “Puede ser utilizado en cualquier superficie interior para interactuar virtualmente con un ordenador. Se podría utilizar para entornos del hogar, para encender aparatos, en un estudio de diseño para trabajar en un concepto, o en un laboratorio, donde interactúen el profesor y el estudiante”.

[YouTube]http://www.youtube.com/watch?v=_AbzMtwaQEk[/YouTube]

你喜欢这篇文章吗?

订阅我们的 通讯 你不会错过任何东西.