El MIT crea un dispositivo de realidad aumentada para ciegos activado por voz

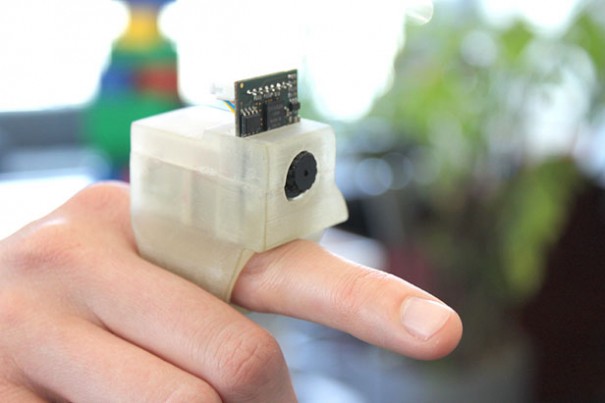

Los investigadores del MIT Media Lab (Instituto de Tecnología de Massachusetts, 欧州連合) han desarrollado un anillo de realidad aumentada equipado con una pequeña cámara, un procesador, conectividad Bluetooth y retroalimentación auditiva a través de un dispositivo portátil, que podría ayudar a los discapacitados visuales a identificar objetos y leer texto.

Un proyecto de varios investigadores del MIT Media Lab tiene como objetivo hacer que apuntar sea una manera de aprender más sobre el mundo que nos rodea, llevando un anillo especial en el dedo índice y un teléfono inteligente en el bolsillo. Bajo el nombre de Eyering, el dispositivo se coloca en el dedo y permite apuntar a un objeto, hacer una foto y escuchar información sobre él.

El proyecto es una creación de Pattie Maes, profesora en el MIT dedicada a estudiar interfaces que nos permitan interactuar con la información digital de formas intuitivas y novedosas. Inicialmente concebido como una ayuda potencial para los discapacitados visuales, el Eyering también podría funcionar como ayuda de navegación o traducción, o para ayudar a los niños a aprender a leer, señalan los investigadores involucrados.

El Eyering, que actualmente se imprime en plástico utilizando una impresora 3D, incluye una pequeña cámara, un procesador y conectividad Bluetooth. Para usarlo, hay que hacer doble clic en un pequeño botón lateral y darle un comando para determinar la función del anillo (en la actualidad se puede configurar para identificar monedas, 文章, precios en etiquetas y colores). Hay que apuntar a aquello de lo que queramos más información, por ejemplo una camisa en un estante, y hacer clic en el botón para tomar una foto. La imagen se envía a través de Bluetooth al teléfono inteligente, donde una aplicación utiliza algoritmos de visión por ordenador para procesarla y después anunciar en voz alta lo que ve (‘verde’, 例えば, para informar sobre el color de la camisa). Los resultados también se muestran en la pantalla del teléfono inteligente.

”Creemos que no tener que sacar el teléfono del bolsillo o bolso y abrirlo es una gran ventaja”, ha indicado Pattie Maes. 今まで, los investigadores han conseguido que Eyering funcione con un teléfono inteligente con software Android de Google y con un ordenador Mac, señala Roy Shilkrot, estudiante graduado en el Fluid Interfaces Group del Media Lab del MIT, y que está trabajando en el dispositivo con Maes. Una aplicación para el iPhone también se encuentra en fase de desarrollo. El grupo ha realizado pruebas del Eyering en personas con discapacidad visual.

この記事は気に入りましたか?

購読してください ニュースレター そして何も見逃すことはありません.